Du hast Dir vorgenommen, Inhalte für Deine Website zu erstellen – eine großartige Entscheidung. Doch genau an diesem Punkt passieren oft die häufigsten Fehler in Sachen Content. Ein Otto Normalverbraucher kann es nicht wissen, aber oft entstehen dabei doppelte Inhalte, die zu internem Wettbewerb führen und Deine Suchmaschinenoptimierung (SEO) behindern. Keine Sorge, das kann vermieden werden! In diesem Artikel erhältst Du Tipps, wie Du Duplicate Content vermeidest und damit Deine SEO-Strategie optimierst.

Was ist Duplicate Content?

Duplicate Content bezeichnet doppelte Inhalte, die sowohl intern als auch extern auftreten können. Intern bedeutet, dass der gleiche Inhalt auf verschiedenen Seiten innerhalb Deiner eigenen Domain vorhanden ist, während extern bedeutet, dass der Inhalt auf verschiedenen fremden Domains erscheint. Suchmaschinen bewerten Duplicate Content negativ, was dazu führt, dass Deine Inhalte keine Chance auf ein positives Ranking haben.

Duplicate Content kann aus verschiedenen Gründen entstehen. Technische Fehler wie unterschiedliche URL-Parameter, das Kopieren von Inhalten von anderen Websites oder das Erstellen mehrerer Seiten mit ähnlichem Inhalt sind häufige Ursachen. Man unterscheidet dabei zwischen internem und externem Duplicate Content. Interner Duplicate Content tritt beispielsweise auf, wenn Druckversionen von Webseiten oder verschiedene URL-Parameter zur gleichen Seite führen. Externer Duplicate Content entsteht oft durch das Kopieren von Inhalten von anderen Websites.

Die Auswirkungen auf die Suchmaschinenoptimierung (SEO) sind erheblich. Suchmaschinen wie Google bevorzugen einzigartige Inhalte und haben Schwierigkeiten zu entscheiden, welche Version des Inhalts angezeigt werden soll, wenn Duplicate Content vorliegt. Dies kann die Sichtbarkeit und das Ranking Deiner betroffenen Seiten beeinträchtigen.

Duplicate Content vermeiden

Duplicate Content kann erhebliche negative Auswirkungen auf die Sichtbarkeit und das Ranking Deiner Webseite in Suchmaschinen haben. Wir haben Dir einige Tipps zusammengestellt, wie Du Duplicate Content effektiv vermeiden kannst:

Richtiger Aufbau der Seitenstruktur

Zu Beginn der Webseitenerstellung solltest Du Dir Gedanken darüber machen, zu welchen Inhalten Deine Seite ranken soll. Eine klare Seitenstruktur ist das A&O für Deinen Erfolg. Diese Struktur sollte immer schlüssig und hilfreich für die Nutzenden sein. Stelle Dir die Frage, welche Themen thematisch geclustert werden sollten und welche Seitenebenen dafür sinnvoll sind.

Beachte auch, dass es keinen Sinn ergibt, Webseiten unter Synonymen anzulegen. Suchmaschinen sind heute so gut, dass sie auch Synonym-Seiten als Duplicate Content erkennen und quasi bestrafen. Eine klare und einfach durchdachte URL-Struktur trägt ebenfalls dazu bei, Duplicate Content zu vermeiden.

Eine Seitenstruktur sollte nicht hastig umstrukturiert werden, wenn kein grundlegender Fehler besteht. Denn bei einer Umstrukturierung gehen Weiterleitungen einher, die Aufwand und Ladezeiten verursachen. Falsch erstellt können dadurch sogar Rankings verloren gehen, die nur schwer oder gar nicht zurückzuholen sind.

URL- und Keyword-Management

Wenn Du die URL, die Du bei jeder Seitenanlage erstellst, in einer Tabelle festhältst und dazu noch das Hauptkeyword notierst, kannst Du dem Problem entgehen, dass Du Dir aufgrund von intern angelegten Inhalten Duplicate Content erschaffst. Jede URL sollte ein eindeutiges Keyword haben, und ein Keyword sollte nicht auf mehreren URLs optimiert werden. Das kann mit einer automatisierten Keywordmap strukturiert werden.

Eine Keywordmap hilft Dir, den Überblick zu behalten und sicherzustellen, dass Deine Keywords strategisch und einzigartig auf Deinen Seiten verteilt sind. Durch die Nutzung einer solchen Map vermeidest Du ungewollte Überschneidungen und stellst sicher, dass Deine Inhalte optimal für Suchmaschinen aufbereitet sind.

Interne Verlinkung

Vielleicht lassen sich die Inhalte auch weiterhin getrennt voneinander behalten, und es bedarf nur einer internen Verlinkung mittels harten Ankers, also einer Verlinkung auf dem Keyword von einer zur anderen URL. Durch diese „harte“ Verlinkung suggerierst Du der Suchmaschine, welcher Inhalt für welches Keyword in den SERPs gelistet werden soll. Solltest Du Dich allerdings entscheiden, eine der beiden Inhalte zu löschen, leite bitte per 301-Weiterleitung die nicht mehr benötigte URL weiter. So stellst Du sicher, dass der Linkjuice erhalten bleibt und die Suchmaschine die neue Struktur versteht.

Canonicals korrekt verwenden

Canonicals helfen, sind aber kein Allheilmittel. Jeder kennt und nutzt Canonicals, und das ist richtig und gut. Ein kleines Manko haben Canonicals allerdings schon: Die Suchmaschinen halten sich nicht immer an die Direktive, die im Head des Dokuments steht, und indexieren die eigentlich abgewertete Seite dennoch.

Zudem können Canonicals auch gefährlich sein. Wenn Du interne Links auf Seiten gesetzt hast, die eigentlich nicht ranken sollen, schadest Du Dir hier erheblich selbst. Des Weiteren musst Du darauf achten, dass Seiten, die ein Canonical auf eine andere Seite haben, NICHT in der Sitemap aufgenommen werden. Die Sitemap ist nach der robots.txt das wichtigste Dokument für einen Bot. Ergo, wenn in der Sitemap die URLs vorhanden sind, werden auch die Canonicals außer Kraft gesetzt, und die ganze Arbeit war umsonst.

Stelle also sicher, dass Du Canonicals korrekt verwendest und Deine Sitemap sauber hältst, um die bestmöglichen Ergebnisse für Deine SEO-Bemühungen zu erzielen.

Passwortschutz und noindex für Entwicklungsumgebung

Es ist so weit: Du baust auf einem Entwicklungsserver Deine Seite auf, fügst alle Inhalte ein und stellst sie dann live. Soweit so gut. Doch was viele dann vergessen, ist, die Entwicklungsumgebung vor der Indexierung zu schützen. Dies ist ein Kardinalfehler, den Du hier begehst. Nicht nur, dass Du jedem Deine Entwicklungsumgebung preisgibst, nein, Du schadest Dir selbst am meisten durch Duplicate Content. Alle Inhalte sind nun sowohl mit der Test- als auch mit der Live-URL in den Suchergebnissen vorhanden. Um diesen Brand jetzt zu löschen, bedarf es mehrerer Maßnahmen:

1. Einrichtung eines Passwortschutzes für die Entwicklungsumgebung

Um einen Passwortschutz festzulegen, benötigst Du den Zugriff auf Deinen Server. Bei einem Apache-Server musst Du eine .htpasswd-Datei anlegen und die .htaccess um einige Zeilen erweitern.

- .htpasswd: Hier sind die Benutzernamen und Passwörter (codiert) gespeichert. Getrennt werden die Inhalte per Doppelpunkt. Jede Zeile bekommt eine Benutzer/Passwort-Kombination.

Beispiel: Emil:$apr1$Ij3xUjpn$brueyPnDzUUth0jyBleVY0

- .htaccess: In der .htaccess muss der Pfad zur Datei, ein Authentifizierungsname sowie die Anweisung „Require valid-user“ eingefügt werden.

Beispiel:

AuthType Basic

AuthName „Passwortgeschützter Bereich“

AuthUserFile /pfad/zur/datei/.htpasswd

Require valid-user

2. In der robots.txt die Zeile „Disallow: /“ einfügen

Dies weist den Bot darauf hin, dass keine Indexierung erfolgen soll/darf

Daher ist es zu Beginn eines Projekts wichtig, bevor es live geht, sich vor allen Unwägbarkeiten zu schützen und erst nach dem Umzug auf die Live-Domain alles auch für die Bots erreichbar zu machen.

Duplicate Content finden

Duplicate Content kann Deine SEO-Bemühungen erheblich beeinträchtigen. Wir zeigen Dir, wie Du doppelte Inhalte auf Deiner Webseite effektiv aufspürst und beseitigst.

Automatisierte Alerts von Google Analytics und Prüfung der SERPs

Es ist immer die Rede davon, dass Du unique Content, also einzigartige Inhalte, produzieren sollst. Dies ist auch soweit richtig. Nur bist Du nicht davor geschützt, dass Deine Inhalte auch auf anderen Seiten, wenn auch in leicht abgewandelter Form, erscheinen. Hierfür gibt es über Google diverse Möglichkeiten. Während in Universal Analytics benutzerdefinierte Benachrichtigungen (Custom Alerts) verwendet wurden, bietet Google Analytics 4 (GA4) nun die Funktion der Custom Insights.

Um Custom Insights in GA4 zu erstellen, gehst Du wie folgt vor:

- Öffne Google Analytics 4.

- Scrolle auf der Startseite Deiner Property nach unten bis zu „Statistiken & Empfehlungen“ und klicke auf „Alle Statistiken ansehen“. Alternativ findest Du dies auch im Bericht-Snapshot.

- Im Bereich Insights klicke auf „Erstellen“.

- Wähle aus den vordefinierten Insights oder erstelle ein neues Insight.

Während der Erstellung der Insights kannst Du folgende Einstellungen vornehmen:

- Häufigkeit der Auswertung: Täglich, wöchentlich etc.

- Segment: Alle Nutzer oder spezifische Nutzergruppen (z. B. Nutzer, die von Paid Social kommen).

- Bedingungen: Definiere, welche Metriken überwacht werden sollen (z. B. mehr als 100 neue Konversionen im Vergleich zur Vorwoche).

- Titel für das Insight

- Benachrichtigungen: Gib die E-Mail-Adressen der Personen ein, die benachrichtigt werden sollen.

Neben dem Alarmsystem von GA4 gibt es auch die Möglichkeit, manuell über das Suchfeld bei Google nach doppelten Inhalten zu suchen. Hierfür nimmst Du einfach eine kurze Textpassage aus Deinem Text und fügst diese in Anführungszeichen in das Suchfeld ein. Jetzt bekommst Du angezeigt, auf welchen Seiten sich die ausgewählte Passage befindet. Wenn nur Deine Domain angezeigt wird, bist Du auf der sicheren Seite und alles ist in Ordnung. Sollten allerdings andere Seiten angezeigt werden, solltest Du die Ergebnisse genau prüfen und reagieren. Wenn Du der Urheber des Textes bist, solltest Du die Betreiber der entsprechenden Seiten kontaktieren oder gegebenenfalls rechtliche Schritte erwägen.

Tools

Es gibt einige Tools, die Sie zur Überprüfung von Duplicate Content einsetzen können:

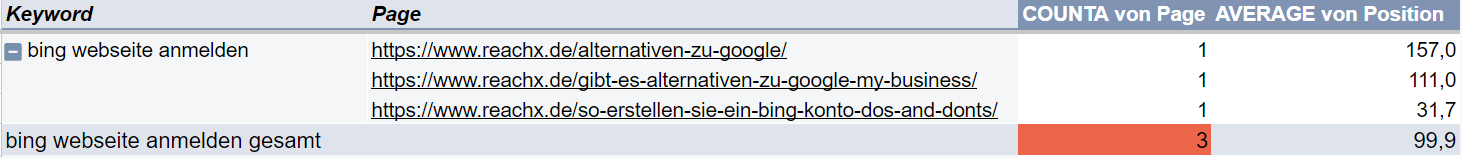

Serplorer

Ein großes Thema neben der Struktur sind auch die Keywords, die auf den vorhandenen URLs ranken. Mit Tools, wie dem Serplorer lassen sich so auf einfache Art und Weise Doppelrankings ermitteln und eliminieren. Die Auswertung des Serplorer erfolgt über die Aufbereitung der Daten aus der Google Search Console. Der Serplorer zeigt so auf, welches Keyword für mehr als eine URL rankt. Wenn Sie nun eine solche Dopplung vorfinden, müssen Sie entscheiden, welche URL weiterhin für dieses Keyword ranken soll. Vergleichen Sie die Inhalte der beiden URL und führen Sie ggf. die beiden Inhalte zusammen.

Siteliner

Der Siteliner ist wie Copyscape ein online Tool. Erreichbar ist der Crawler unter: http://www.siteliner.com/ und findet neben doppelten Inhalten auch noch Broken Links u. v. m. Zum Vorschein.

Screaming Frog

Der Screaming Frog ist ein sehr mächtiges Tool. Hier kann ein Crawl der eigenen Seite gemacht werden, um internen Duplicate Content aufzuspüren, aber auch externer DC über den Upload einer Liste abgefragt werden. https://www.screamingfrog.co.uk/seo-spider/

GSC x Google Sheets

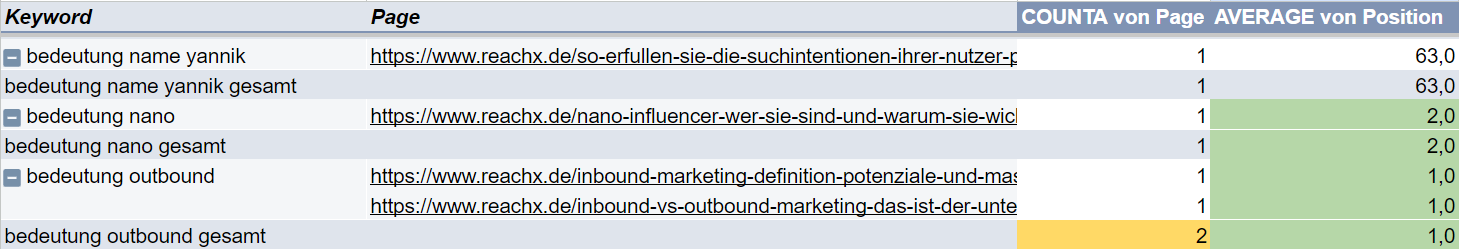

Mit der Erweiterung „Google Search Analytics for Sheets“ kannst Du die Keywords, die zu Deinen URLs ranken, zusammen mit der Position und der CTR auflisten. Dadurch kannst Du eine ausführlichere und übersichtlichere Analyse durchführen. Wenn Du nach den Keywords filterst oder eine Pivot-Tabelle erstellst, kannst Du erkennen, wie viele URLs für ein Keyword ranken.

Erscheinen mehrere URLs für ein Keyword, musst Du überprüfen, ob sich die Inhalte bzw. die Positionen der Keywords tatsächlich gegenseitig im Weg stehen und ob eine Optimierung vorgenommen werden sollte. In manchen Fällen ist keine Optimierung nötig, da die Positionen der Keywords so hoch sind, dass sich die URLs nicht im Weg stehen. Es besteht in solchen Fällen kein Ranking-Konflikt.

Bei diesem Beispiel kannst Du überlegen, ob das Keyword lieber zusammengefasst werden sollte, damit nur eine URL dafür rankt, oder ob sogar ein ganz neues Thema für das Keyword „Bedeutung Outbound“ entstehen sollte.

Fazit: Duplikate erkennen und beseitigen

Duplicate Content ist schlimm, wenn er vorhanden ist. Welche Maßnahmen Du zur Vermeidung von Duplicate Content einsetzt, ist voll und ganz Dir überlassen. Nur sei Dir bitte im Klaren, dass Du immer mit der nötigen Sorgfalt an die Erstellung einer Website und des zu erstellenden Contents herangehen solltest. Nimm Dir die nötige Zeit, die richtigen, einzigartigen Inhalte zu erstellen. Beachte aber bitte auch, dass Canonicals nicht immer die richtige Wahl sind. Egal, wie groß Deine Seite ist, behalte den internen und auch externen Duplicate Content im Auge.

Gegen externen Duplicate Content bist Du nicht direkt verantwortlich, aber Du musst ihn bekämpfen. Solltest Du jedoch internen Wettbewerb aufbauen, stehst Du dafür selbst gerade. Wenn es doppelte Inhalte gibt, ist das Kind noch lange nicht in den Brunnen gefallen. Durch die vorgenannten Tipps bist Du auf einem guten Weg zu einer Website ohne internen und externen Duplicate Content. Schau Dir die vorgeschlagenen Tools an und probiere sie aus. Bei allen Tools gibt es entweder Test- oder Freeversionen. Finde so für Dich das passende Check-Tool heraus und bringe Deine Webseite auf einen TOP-Stand. Gib Duplicate Content kein Zuhause und habe Deine Webseite im Griff.

Jetzt Unterstützung in SEO erhalten